So prüfen Sie Unternehmen für individuelle Softwareentwicklung

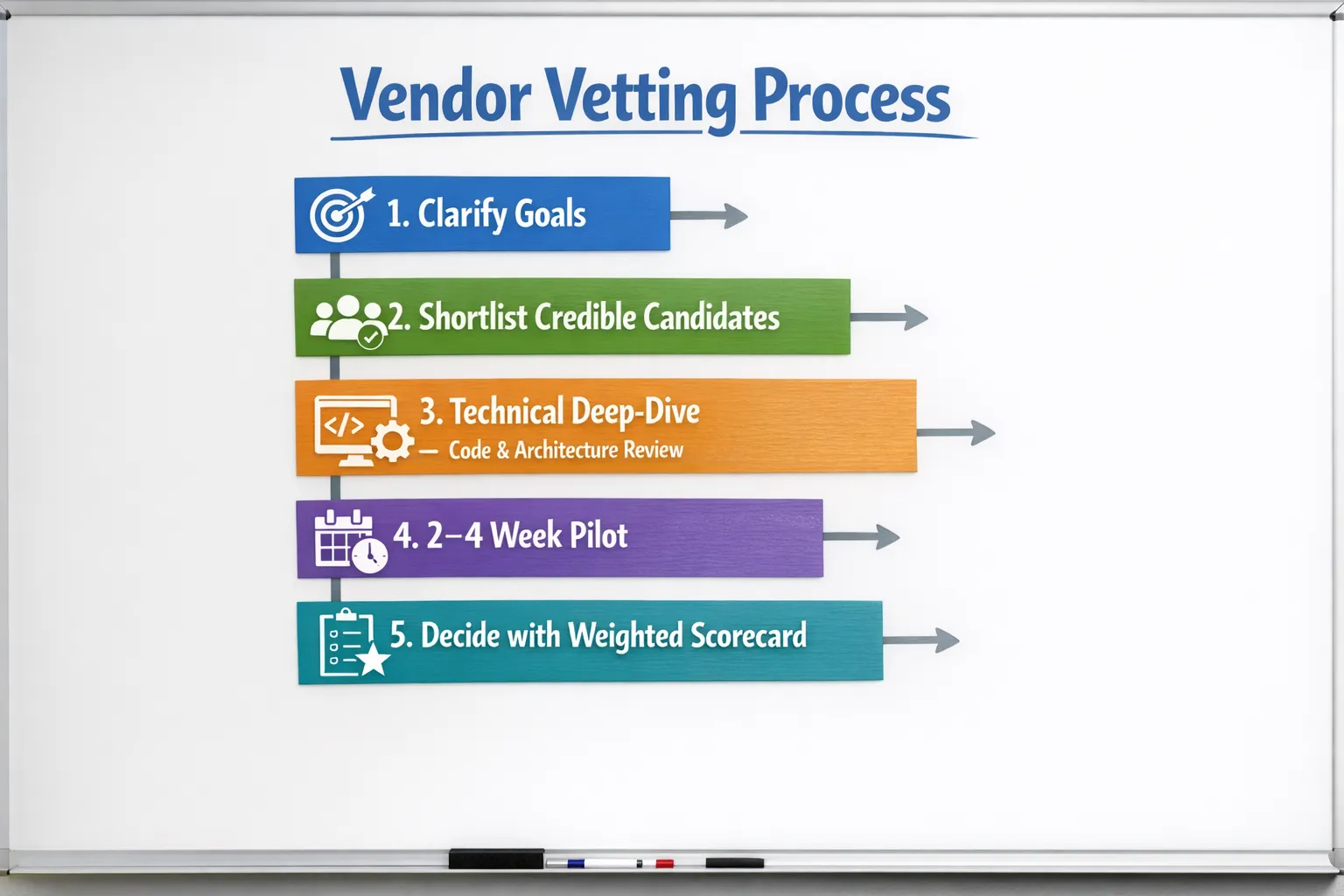

Den falschen Partner zu beauftragen ist teuer, langsam und schwer rückgängig zu machen. Den richtigen zu finden kann Zeitpläne verkürzen, Risiken reduzieren und Sie langfristig auf Geschwindigkeit bringen. Dieser Leitfaden gibt Ihnen ein praktisches Framework, Fragen und Nachweise, die Sie anfordern sollten, wenn Sie 2025 Unternehmen für individuelle Softwareentwicklung prüfen. Nutzen Sie ihn, um polierte Vertriebsrhetorik von operativer Realität zu trennen.

Starten Sie mit Ergebnissen, dann Rahmenbedingungen

Bevor Sie Anbieter bewerten, definieren Sie Erfolg für Ihr Vorhaben. Gute Partner werden diese Eingaben hinterfragen und verbessern.

- Geschäftsergebnisse: Umsatzziele, Kostenreduzierung, Kunden-KPIs, Compliance-Ergebnisse.

- Umfang und Grenzen: Must-have-Fähigkeiten, Integrationen, Datendomänen, Rollout-Phasen.

- Nicht-funktionale Anforderungen: Verfügbarkeitsziele, Latenz, Datenschutz, Barrierefreiheit, Analytics.

- Praktische Rahmenbedingungen: Budgetrahmen, Zeitfenster, Teamverfügbarkeit, Abhängigkeiten.

- Risikoprofil: Regulierte Daten, Datenresidenz, Vendor-Lock-in-Toleranz, Change Management.

Für einen tiefergehenden Einstieg in die Ausrichtung von Technologie auf Ergebnisse siehe How to Choose the Right Tech Stack in 2025.

Eine glaubwürdige Shortlist erstellen

- Suchen Sie nach Problem- und Branchennähe, nicht nur nach generischen Portfolios. Bevorzugen Sie Unternehmen, die ähnliche Größenordnung, Komplexität oder Compliance-Anforderungen geliefert haben.

- Achten Sie auf öffentliche technische Signale: Open-Source-Beiträge, Vorträge, Fachartikel und Nachweis moderner Praktiken.

- Fordern Sie zwei relevante Fallstudien an, idealerweise mit messbaren Ergebnissen und Rahmenbedingungen ähnlich zu Ihren.

- Vermeiden Sie Massen-Ausschreibungen. Nutzen Sie ein prägnantes RFI zum Filtern, führen Sie dann eine strukturierte Tiefenanalyse mit 3 bis 5 Anbietern durch.

Wenn Ihr Fokus auf Webanwendungen liegt, hilft diese begleitende Checkliste bei der Kriterienbildung: Top Traits of Web Application Development Companies.

Ein praktisches Prüfungsframework: Acht Dimensionen zur Bewertung

Nachfolgend die Dimensionen, die zuverlässig die Lieferqualität vorhersagen. Für jede listen wir auf, wie "gut" aussieht und welche Nachweise Sie anfordern sollten.

1) Discovery und Produktdenken

- Nachweis von Problemrahmung, Nutzerforschungsplänen und Erfolgskennzahlen, nicht nur Features und Stunden.

- Klare Annahmen, Risiken und ein schlanker Lieferplan, der Unsicherheit früh reduziert.

- Nachweise anfordern: Eine Beispiel-Discovery-Agenda, eine einseitige Ergebnishypothese, ein Backlog-Ausschnitt mit Akzeptanzkriterien.

2) Engineering-Grundlagen

- Modularität, klare Grenzen, testbare Einheiten und explizite Architekturentscheidungen.

- Automatisierte Tests, Code Reviews, CI-Checks und Trunk-basierte Entwicklung.

- Vertrautheit mit den vier DORA-Schlüsselmetriken: Deployment-Frequenz, Lead Time, Change Failure Rate, Time to Restore und warum sie wichtig sind. Siehe die DORA-Forschung.

- Nachweise anfordern: Anonymisierter Repo-Snapshot oder Code-Auszug, CI-Pipeline-Konfiguration, einige Architecture Decision Records, Testabdeckungszusammenfassung und eine einfache Definition of Done.

3) Security und Compliance by Design

- Sicherer SDLC orientiert an NIST SSDF und OWASP ASVS.

- Supply-Chain-Integrität: SBOMs und Provenance, zum Beispiel SLSA-Leitlinien, siehe slsa.dev, Dependency- und Container-Scanning, Secrets Management.

- Angemessene Zertifizierungspostur: SOC 2 Type II oder ISO/IEC 27001, wenn sensible Daten verarbeitet werden.

- Nachweise anfordern: Sichere Programmierstandards, Schwachstellenmanagement-Workflow, Beispiel-SBOM, Incident-Response-Playbook, aktülle Bescheinigungen oder Prüfberichte, falls zutreffend.

4) Cloud, DevOps und Zuverlässigkeit

- Infrastructure as Code, Umgebungsparität und wiederholbare Bereitstellung.

- Observability fest integriert: Metriken, Logs, Tracing, SLOs und Error Budgets, On-Call-Erwartungen.

- Kostenbewusstsein und Right-Sizing-Muster plus ein Plan für vorhersagbare Umgebungen.

- Nachweise anfordern: Beispiel Terraform- oder ähnliches IaC-Snippet, Runbook für einen kritischen Service, Monitoring-Dashboard-Beschreibung, Kostenschätzungsannahmen.

5) Daten- und API-Design

- Klare Domänenmodell-Grenzen, Datenqualitätsregeln und Aufbewahrungsrichtlinien.

- Stabile API-Verträge, Versionierungsstrategie, Paginierung und Rate Limits, Rückwärtskompatibilität.

- Nachweise anfordern: Eine Beispiel-OpenAPI-Spezifikation, Datenmodelldiagramm, Performance- oder Lasttest-Entwurf.

6) UX, Barrierefreiheit und Performance

- Inklusives Design und WCAG 2.2 AA Bewusstsein, Performance Budgets, Design Systems und Komponenten-Wiederverwendung.

- Nachweise anfordern: Barrierefreiheitserklärung, Beispiel-Audit-Checkliste, ein Lighthouse-Budget oder gleichwertige Performance-Schwellenwerte.

7) Delivery-Management und Kommunikation

- Rhythmus von Planung und Demos, transparente Risikoprotokolle, proaktives Stakeholder-Management, Zeitzonen-Überlappungsplan.

- Klarheit zur Teamzusammensetzung: Senioritätsmix, Backfills und explizite Haltung zu Subunternehmern.

- Nachweise anfordern: RACI- und Kommunikationsplan, Beispiel-Statusbericht, Besetzungsplan mit benannten Rollen.

8) Kommerzielles, Rechtliches und Risiko

- Preismodell passend zur Unsicherheit: Time and Materials für Discovery, ergebnis- oder meilensteinbasierte Preise für spätere Phasen.

- Änderungskontrolle, die Lernen nicht bestraft, IP-Übertragung und Lizenzklarheit, Datenverarbeitungs- und Datenschutzbedingungen, Gewährleistung und Abnahmekriterien.

- Nachweise anfordern: SOW-Vorlage mit Leistungsdefinition, Beispiel-Änderungsantrag, DPA-Vorlage falls relevant.

Führen Sie einen praktischen Piloten durch, um Behauptungen zu validieren

Mundliche Zusicherungen reichen nicht. Fordern Sie einen 2- bis 4-wöchigen Piloten an, der einen dünnen vertikalen Schnitt behandelt: eine kleine Ende-zu-Ende-Fähigkeit, die Architektur, Daten, UI, Deployment und Quality Gates überprüft.

Pilot-Abnahmekriterien zur Berücksichtigung:

- Funktionierende Software, deployed in eine Staging-Umgebung, auf die Sie zugreifen können.

- Test- und CI-Pipeline läuft bei jedem Commit mit aussagekräftigen Prüfungen.

- Leichtgewichtige Dokumentation: ADRs und ein Readme, das einen neuen Entwickler in unter 30 Minuten einrichten lässt.

- Observability für den Schnitt vorhanden: Grundlegende Metriken und Logs sichtbar.

- Eine Demo mit Fragerunde und ein offenes Retro, das Risiken und nächste Schritte aufdeckt.

Stellen Sie diese Verifikationsfragen

- Was haben Sie aus einem Projekt gelernt, das schiefgelaufen ist, und wie haben Sie danach Ihren Prozess angepasst?

- Zeigen Sie ein Vorher-Nachher einer Legacy-Modernisierung. Welche technische Schuld wurde abgebaut und wie wurde das Risiko kontrolliert?

- Welche DORA-Metriken tracken Ihre Teams, wie, und was haben Sie aufgrund der Daten geändert?

- Wie handhaben Sie Secrets, Zugangsdaten und Abhängigkeits-Schwachstellen projektübergreifend?

- Wie ist Ihre Richtlinie zu KI-gestützter Programmierung und Datenschutz, und wie verhindern Sie IP-Abfluss?

- Wann und warum wählen Sie einen modularen Monolithen gegenüber Microservices?

Für modernisierungslastige Vorhaben helfen diese Vertiefungen: Refactoring Legacy Software: From Creaky to Contemporary und Code Modernization Techniques: Revitalizing Legacy Systems.

Häufige Warnsignale

- Vage Angebote mit vielen Tools und Frameworks, aber ohne Ergebnis- oder Risikorahmung.

- Keine Code-Beispiele, keine ADRs und keine CI-Screenshots, selbst nach NDA.

- Jede Frage wird mit Microservices, Serverless oder einem Lieblingsframework beantwortet, unabhängig von Ihrem Kontext.

- Security wird als späte Phase dargestellt. Keine Erwähnung von OWASP ASVS, Threat Modeling oder SBOM.

- Senior-Team im Vertrieb präsentiert, Junior-Team in der Umsetzung besetzt, Verfügbarkeit unbekannt.

- "Festpreis, Festumfang" für mehrdeutige Probleme, mit Änderungskontrolle, die Lernen bestraft.

Eine wiederverwendbare Anbieter-Scorecard

Passen Sie die Gewichtungen an Ihre Prioritäten an und bewerten Sie Anbieter nach Tiefenanalyse und Pilot.

| Kategorie | Wie "gut" aussieht | Nachweise anfordern | Gewicht |

|---|---|---|---|

| Discovery und Produktdenken | Ergebnisse, Risiken, schlankes Backlog | Discovery-Agenda, Ergebnishypothese | 15 |

| Engineering-Grundlagen | Tests, ADRs, CI, Reviews, klare Grenzen | Repo-Auszug, CI-Konfiguration, Abdeckungsbericht | 20 |

| Security und Compliance | Sicherer SDLC, SSDF, ASVS, SBOM, Audits | Richtlinien, SBOM, Incident-Playbook, Bescheinigungen | 15 |

| Cloud und DevOps | IaC, SLOs, Observability, Kostenbewusstsein | IaC-Snippet, Runbook, Dashboard-Übersicht | 10 |

| Daten und APIs | Versionierung, Verträge, Datenqualität | OpenAPI, Schema, Performance-Testplan | 10 |

| UX und Barrierefreiheit | WCAG 2.2 AA, Performance Budgets | Barrierefreiheits-Checkliste, Performance-Budget | 5 |

| Delivery und Kommunikation | Rhythmus, Risikotransparenz, Besetzungsklarheit | Statusbeispiel, RACI, Besetzungsplan | 10 |

| Kommerzielles und Rechtliches | Faire Änderungskontrolle, IP-Klarheit, DPA | SOW-Vorlage, Änderungsantrag, DPA | 10 |

| Referenzen und Ergebnisse | Relevanter Erfolg mit Kennzahlen | Zwei Referenzen mit Kontakt, Fallstudie | 5 |

Gesamtgewicht: 100.

RFI und RFP: Halten Sie es schlank

- RFI-Ziel: Schnell filtern. Fragen Sie nach Domänen-Fit, Teamzusammensetzung, Sicherheitspostur und zwei Fallstudien.

- RFP-Ziel: Einen Lösungsvorschlag strukturieren. Liefern Sie ein prägnantes Problemstatement, Rahmenbedingungen, zentrale nicht-funktionale Anforderungen, ein Beispiel-Datenmodell oder API, Compliance-Anforderungen und Akzeptanzkriterien-Beispiele.

- Fordern Sie eine 1- bis 2-stundige technische Fragerunde, damit Anbieter klären können und nicht raten müssen.

Wenn Sie eine Greenfield-Webanwendung planen, hilft dieser Einstiegsleitfaden bei der Strukturierung: Web Apps Development: A Practical Starter Guide.

Portfolios und Referenzen richtig validieren

- Sprechen Sie mit einem Sponsor und einem Entwickler des Referenzkunden. Fragen Sie, was sie überrascht hat und was sie ändern würden.

- Fragen Sie nach Trends bei Change Failure Rate und Lead Time während des Engagements. Suchen Sie nach Verbesserung über die Zeit, nicht nach Perfektion.

- Prüfen Sie, wer die Arbeit tatsächlich geleistet hat: Festangestellte oder Subunternehmer, und wie Kontinuität sichergestellt wird.

KI-Nutzung und IP-Schutz in 2025

- Fragen Sie nach der KI-Richtlinie des Anbieters: Welche Tools sind erlaubt, welche Telemetrie ist deaktiviert und wie werden Prompts und Code geschützt.

- Fordern Sie eine Haltung zu Trainingsdaten, Lizenzeinhaltung und wie generierter Code auf rechtliche und Sicherheitsrisiken geprüft wird.

- Stellen Sie sicher, dass sensible Daten nie genehmigte Grenzen verlassen und dass Code-Assistenten im Enterprise-Modus genutzt werden, wenn verfügbar.

Engagement-Modelle und Besetzungsmechanismen

- Time and Materials passt zu Discovery und sich entwickelndem Umfang; meilensteinbasierte Preise können funktionieren, sobald das Risiko reduziert ist.

- Bestehen Sie auf Transparenz bei benannten Rollen, Senioritätsmix und einem Plan für Vertretungen und Urlaub.

- Klären Sie Zeitzonen-Überlappungserwartungen und Meeting-Rhythmus.

Vertragliche Muss-Anforderungen

- Klare Leistungen und Abnahmekriterien mit objektiven Tests, wo möglich.

- IP-Übertragung, Open-Source-Lizenzeinhaltung und Verantwortlichkeiten für Drittanbieterlizenzen.

- Datenverarbeitungsvertrag bei Bedarf, Meldepflichten bei Datenschutzverletzungen und Sicherheitsverpflichtungen.

- Service Levels und Incident-Response-Erwartungen für den Produktionsbetrieb.

- Angemessene Kundigungsrechte und Wissenstransfer-Pflichten zur Vermeidung von Lock-in.

Gesamtbetriebskosten, nicht nur Tagessätze

- Umgebungs- und Infrastrukturkosten: Umgebungen pro Stufe, Datenspeicher, Observability und CI-Runner.

- Laufender Support, Gewährleistung, Bugfixes und Wartungskonzept.

- Bezahlte Discovery und Piloten, die Risiko früh abbauen, reduzieren oft die Gesamtausgaben.

Wo Wolf-Tech ins Bild passt

Wolf-Tech ist spezialisiert auf individuelle digitale Lösungen, Full-Stack-Entwicklung, Legacy-Code-Optimierung, Code-Quality-Consulting sowie Cloud- und DevOps-Expertise. Wenn Sie eine zweite Meinung zu einem Angebot, eine Code-Quality-Bewertung oder einen Modernisierungsansatz wünschen, können wir Ihnen helfen, Risiken zu reduzieren, bevor Sie sich festlegen. Erkunden Sie unseren Engineering-Ansatz in Next.js Best Practices for Scalable Apps und erfahren Sie, wie wir über Modernisierung denken in Refactoring Legacy Applications: A Strategic Guide.

Häufig gestellte Fragen

Wie viele Anbieter sollte ich evaluieren? Drei bis fünf reichen in der Regel, um aussagekräftige Unterschiede zu erkennen, ohne in Analyselahmung zu verfallen.

Was, wenn Anbieter keine Code-Beispiele teilen wollen? Fragen Sie nach anonymisierten Auszügen unter NDA oder einem kleinen Pilot-Repository. Wenn sie trotzdem ablehnen, ist das ein Signal.

Brauche ich einen Festpreis, um das Budget zu kontrollieren? Festpreise können bei klar definiertem Umfang funktionieren. Für Discovery oder Innovation liefern Time and Materials mit engen Meilensteinen und Demos oft bessere Ergebnisse.

Welche Zertifizierungen sind am wichtigsten? Das hängt von Ihren Daten und Ihrer Branche ab. SOC 2 Type II oder ISO/IEC 27001 sind gängig für Sicherheitsmanagement. Bilden Sie Anwendungskontrollen auf OWASP ASVS und sichere SDLC-Leitlinien wie NIST SSDF ab.

Wie lang sollte ein Pilot sein? Zwei bis vier Wochen sind typisch. Das Ziel ist, Passung und Arbeitsmodi zu validieren, nicht Produktionsumfang zu bauen.

Wie vergleiche ich Nearshore, Offshore und Onshore? Optimieren Sie nach Überlappungsstunden, Kommunikationsqualität und Senioritätskontinuität. Tagessätze sind nur ein Teil der Gleichung.

Welche KPIs sollte ich während der Umsetzung anfordern? Tracken Sie Lead Time, Deployment-Frequenz, Change Failure Rate und Time to Restore. Fügen Sie SLOs für zentrale Nutzerreisen hinzu.

Was ist eine angemessene Gewährleistung? Viele Anbieter bieten ein Mängel-Gewährleistungsfenster. Klären Sie Umfang, Fristen für Fixes und wie Schweregrade in Ihrem SOW klassifiziert werden.

Bereit, Ihr Anbieterrisiko zu reduzieren?

Nutzen Sie die obige Scorecard für einen konsistenten Prozess, validieren Sie mit einem praktischen Piloten und fordern Sie Nachweise, die zu Ihren Ergebnissen passen. Wenn Sie Hilfe bei der Prüfung von Angeboten oder der Gestaltung eines risikoarmen Lieferplans wünschen, sprechen Sie mit Wolf-Tech. Wir bringen 18 Jahre Full-Stack-Erfahrung, Code-Quality-Consulting, Legacy-Optimierung sowie Cloud- und DevOps-Expertise mit, um Ihnen zu helfen, den richtigen Weg zu wählen. Starten Sie das Gespräch unter Wolf-Tech.