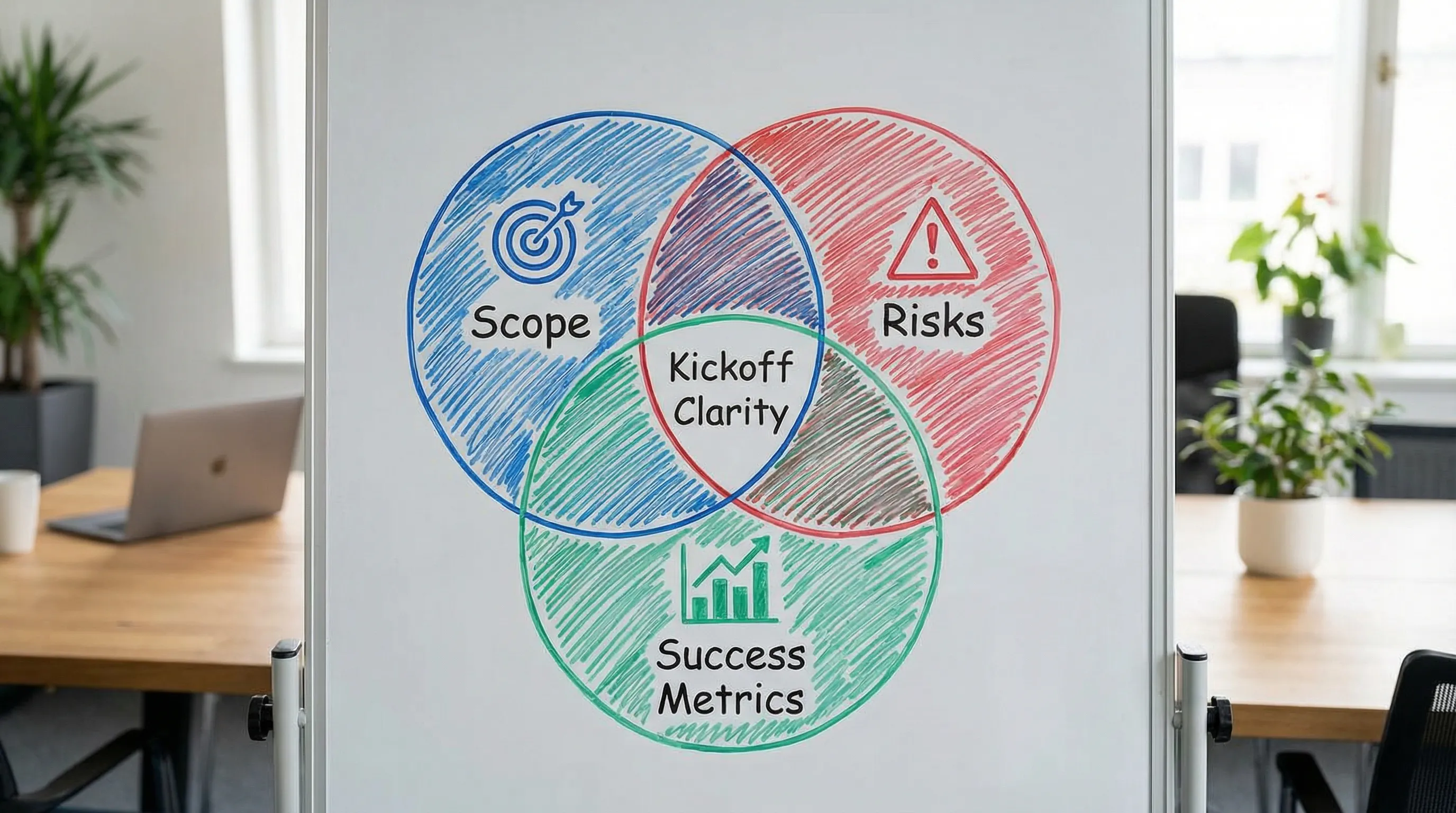

Software-Projekt-Kickoff: Umfang, Risiken und Erfolgskennzahlen

Ein Software-Projekt-Kickoff entscheidet, ob man Geschwindigkeit durch Klarheit erkauft – oder still Nacharbeitung durch Mehrdeutigkeit.

Die meisten „Projektmisserfolge" entstehen nicht durch einen einzelnen schlechten Sprint. Sie entstehen durch drei vermeidbare Probleme, die sich am ersten Tag zeigen:

- Umfang, der nicht testbar ist (alle sind im Meeting einig, niemand ist zwei Wochen später einig)

- Risiken, die bekannt, aber unbenannt sind (und daher nie mitigiert werden)

- Erfolgskennzahlen, die implizit sind (sodass Fortschritt subjektiv wird)

Dieser Leitfaden bietet eine praktische Kickoff-Struktur, die auf Umfang, Risiken und Erfolgskennzahlen fokussiert ist, mit Templates, die für interne Teams und anbietergeführte Lieferung wiederverwendet werden können.

Was ein Software-Projekt-Kickoff ist (und was nicht)

Ein Kickoff ist keine Folienpräsentation über „wie wir arbeiten" und kein detaillierter Anforderungsworkshop.

Ein guter Kickoff ist eine Entscheidungsfindungssitzung, die Artefakte erzeugt, die das Team in den ersten 2 bis 6 Wochen tatsächlich nutzen wird:

- Eine Umfangsdefinition, die gegen gelieferte Arbeit validiert werden kann

- Ein Risikoregister mit Verantwortlichen und kurzfristigen Mitigationen

- Einen Messplan (Geschäftsergebnisse, Lieferungsgesundheit und Produktionsergebnisse)

- Einen gemeinsamen Betriebsrhythmus (wie Entscheidungen getroffen werden, was „fertig" bedeutet, wie Releases gehandhabt werden)

Wenn das Projekt mehrere Stakeholder, externe Abhängigkeiten, regulierte Daten oder Legacy-Integration umfasst, ist der Kickoff das Meeting mit dem höchsten Hebel.

Umfang: testbar machen, nicht inspirierend

Das Kickoff-Ziel ist, von „wir wollen X" zu „wir liefern Y bis Datum Z, unter Einschränkungen C, und wir wissen, dass es funktioniert hat, wenn Metrik M sich bewegt."

Mit Ergebnissen beginnen, dann den Slice einschränken

Ein messbares Ergebnis pro primärem Stakeholder anfordern. Beispiele:

- Onboarding-Zeit von 20 Minuten auf 8 Minuten reduzieren

- Angebots-zu-Cash-Durchsatz um 30 Prozent erhöhen

- Einen manuellen CSV-Prozess durch einen geprüften Workflow ersetzen

Dann den Umfang mit einem dünnen vertikalen Slice einschränken, der die Produktion erreicht. Für eine tiefere Anleitung dazu bietet Wolf-Techs Leitfaden über einen praktischen Lieferprozess eine gute Ergänzung: Software bauen: ein praktischer Prozess für vielbeschäftigte Teams.

Grenzen explizit definieren (im Umfang, außerhalb des Umfangs und „später")

Scope Creep entsteht oft durch Kategorienfehler. Jemand fragt nach einer „kleinen Änderung", die tatsächlich ist:

- Ein neues Rollen- und Berechtigungsmodell

- Ein neuer Integrationsvertrag

- Eine neue Audit- oder Berichtspflicht

- Eine neue Performance-Erwartung

Beim Kickoff dokumentieren, was außerhalb des Umfangs liegt, mit derselben Ernsthaftigkeit wie was im Umfang liegt. „Später"-Punkte sollten erfasst, aber nicht versprochen werden.

Nicht-funktionale Anforderungen früh erfassen

Nicht-funktionale Anforderungen (NFRs) sind Umfang. Sie verändern Architektur, Kosten und Zeitpläne.

Typische NFRs, die beim Kickoff zu klären sind:

- Verfügbarkeits- und Zuverlässigkeitsziele (SLOs)

- Performance-Budgets (Latenz, Parallelität)

- Security- und Compliance-Einschränkungen (PII, PCI, SOC-2-Erwartungen)

- Datenhaltung und Auditierbarkeit

- Deployment-Frequenzerwartungen

Wolf-Tech behandelt diese „messbare NFRs zuerst"-Denkweise in mehreren Artikeln, einschließlich Softwarelösungen entwickeln, die wirklich skalieren.

Ein Umfangsdefinitions-Template zum Wiederverwenden

Eine einseitige Umfangsdefinition nutzen, die kurz genug ist, um wöchentlich gelesen zu werden.

| Umfangselement | Was „gut" aussieht | Beispiel-Prompt für den Kickoff |

|---|---|---|

| Ergebnis | Messbarer Wandel, keine Feature-Liste | „Was ändert sich für Nutzer oder das Unternehmen?" |

| Primäre Nutzer | Benannte Personas und ihre Aufgaben | „Wer ist der primäre Nutzer am ersten Tag?" |

| Enthaltene Fähigkeiten | Verben, keine Module | „Nutzer können einreichen, genehmigen und exportieren…" |

| Außerhalb des Umfangs | Explizite Ausschlüsse | „Kein individuelles Reporting in Phase 1" |

| Einschränkungen | Zeit, Compliance, Tech, Anbieter | „Muss bestehenden IdP und Audit-Trail verwenden" |

| Abhängigkeiten | Systeme, Teams, Anbieter | „ERP-Integrationsvertrag noch nicht bestätigt" |

| Akzeptanzsignale | Belege, keine Meinungen | „Demo + automatisierte Tests + Prod-Telemetrie" |

Wenn bereits eine MVP-Idee vorhanden ist, kann man sie gegen eine detailliertere Bereitschaftsliste prüfen wie Apps bauen: MVP-Checkliste für schnellere Launches.

Risiken: früh benennen, dann abbauen

Ein Kickoff sollte ein kurzes Pre-Mortem umfassen: „Es ist 90 Tage von heute und dieses Projekt hat alle enttäuscht, was ist passiert?"

Dann die Antworten in ein Risikoregister mit Verantwortlichen übersetzen.

Risikokategorien, die bei echten Projekten wichtig sind

Die meisten Risiken fallen in einige wenige Kategorien. Die Kategorie zu benennen hilft, die richtige Mitigation zu wählen.

| Risikokategorie | Typisches Frühsignal | Praktische Mitigation (Kickoff-Ebene) |

|---|---|---|

| Produktrisiko | Stakeholder sind sich über „fertig" uneinig | Akzeptanzsignale schreiben, dünnen Slice definieren, Change-Control-Regel setzen |

| Technisches Risiko | Unbekanntes Legacy-Verhalten | Vertikalen Slice gegen echte Umgebungen ausführen, Nähte und Contract-Tests priorisieren |

| Integrationsrisiko | Externe API unklar oder instabil | Sandbox-Zugang anfordern, API-Verträge definieren, Mocks und Fehlermodustests erstellen |

| Lieferungsrisiko | Teilzeit-Fachexperten, unklare Entscheidungsrechte | DRIs zuweisen, wöchentliches Entscheidungsforum setzen, Eskalationspfade definieren |

| Security/Compliance-Risiko | Datenklassifikation unbekannt | Daten klassifizieren, Baseline-Kontrollen wählen, benötigte Audit-Belege abstimmen |

| Betriebsrisiko | „Wir fügen Monitoring später hinzu" | SLIs/SLOs, Log/Trace-Anforderungen und Rollback-Strategie vor dem Launch definieren |

Wenn das Projekt bedeutendes Delivery-System-Risiko hat (langsame Merges, manuelle Deployments, unklare Release-Kontrollen), ist der Kickoff der richtige Zeitpunkt, Erwartungen für CI/CD und Release-Sicherheit zu setzen. Referenz: CI/CD-Technologie: schneller bauen, testen, deployen.

„Risiko-Burn-down"-Arbeit nutzen, nicht nur Dokumentation

Ein Risikoregister ist nur nützlich, wenn es in den ersten Iterationen Arbeit antreibt. In der Praxis tendieren die ROI-stärksten Mitigationen dazu:

- Ein produktionsreifer dünner Slice (echte Auth, echte Datenstruktur, echter Deployment-Pfad)

- Contract-Tests für die fehleranfälligsten Integrationen

- Observability-Baseline (Logs, Metriken, Tracing) vor Feature-Breite

- Klare Rollout-Kontrollen (Feature-Flags, Canary- oder phasenweiser Release, Rollback-Plan)

Für operative Sicherheitsmuster, die den Blast-Radius reduzieren, ist das Google SRE-Buch eine glaubwürdige Referenz, besonders rund um SLO-Denken.

Erfolgskennzahlen: Leitindikatoren und nachlaufende Ergebnisse abstimmen

Projekte driften, wenn „Fortschritt" für verschiedene Menschen Verschiedenes bedeutet. Der Kickoff sollte einen Messstack abstimmen, der drei Fragen beantwortet:

- Liefern wir effektiv?

- Funktioniert das Produkt in der Produktion?

- Verbessert sich das Geschäftsergebnis?

Lieferungsmetriken (Engineering-Gesundheit)

Lieferungsmetriken sind nicht das Ziel, aber sie sagen voraus, ob man anpassen kann.

Das meistgenutzte Set ist DORA, popularisiert durch die Forschung hinter Accelerate und weitergeführt durch Googles DORA-Forschungsprogramm. Diese fokussieren auf Geschwindigkeit und Stabilität gemeinsam: DORA research.

DORA-Metriken beim Kickoff nutzen, wenn Lieferungseinschränkungen explizit gemacht werden müssen:

- Deployment-Frequenz

- Lead-Time für Änderungen

- Change-Failure-Rate

- Time-to-Restore

Produktionsmetriken (Zuverlässigkeit und Performance)

Mindestens ein Service Level Objective (SLO) pro nutzerkritischem Flow definieren. Einfach halten.

Beispiele:

- „Checkout-API: 99,9 Prozent Erfolgsrate wöchentlich, p95-Latenz unter 400 ms"

- „Report-Generierung: 95 Prozent in unter 2 Minuten abgeschlossen"

Diese wenn möglich an ein Error-Budget-Konzept knüpfen, auch informell. Das schafft einen rationalen Weg zu entscheiden, wann Feature-Arbeit pausiert wird, um Zuverlässigkeit zu reparieren.

Geschäftsmetriken (Wert)

Eine primäre Geschäftsmetrik pro Ergebnis wählen, plus eine oder zwei unterstützende Metriken. Eitelkeitsmetriken vermeiden.

Beispiele:

- Primär: Aktivierungsrate

- Unterstützend: Onboarding-Abschlusszeit, Support-Ticket-Rate für Onboarding

Eine einfache Erfolgskennzahlen-Matrix

| Metriktyp | Beispielmetrik | Verantwortlich | Messung | Überprüfungsrhythmus |

|---|---|---|---|---|

| Geschäftsergebnis | Onboarding-Abschlussrate | Product | Event-Analytics mit definiertem Funnel | Wöchentlich |

| Nutzererfahrung | p95-Seitenladezeit für Schlüsselroute | Engineering | RUM + Core-Web-Vitals-Dashboard | Wöchentlich |

| Zuverlässigkeit | Erfolgsrate für kritische API | Engineering | SLI aus Metriken, Alert-Schwellenwerte | Wöchentlich |

| Lieferungsgesundheit | Lead-Time für Änderungen | Eng-Manager | CI/CD-Zeitstempel, PR-Cycle-Time | Zweiwöchentlich |

| Qualität | Defekt-Escape-Rate | QA/Engineering | Incidents und Bug-Intake nach Releases getaggt | Monatlich |

Eine wichtige Kickoff-Entscheidung ist, wo diese Metriken leben, wer auf sie zugreifen kann und was eine „echte Baseline" ausmacht (typischerweise 1 bis 2 Wochen Produktionstelemetrie).

Eine praktische Kickoff-Agenda, die in eine Session passt

Für viele Teams reichen 90 bis 180 Minuten, solange man vorbereitet kommt.

Vorarbeit (asynchron)

Folgendes vor dem Meeting anfordern:

- Ein Absatz Problemdefinition und Zielnutzer

- Bekannte Einschränkungen (Compliance, Termine, Anbieter)

- Bestehender Architekturkontext (beteiligte Systeme, aktuelle Schmerzpunkte)

- Nicht verhandelbare Technologieeinschränkungen

Wenn unklar ist, welche Artefakte wichtig sind, ist Wolf-Techs Architektur-Review-Checkliste eine nützliche Anleitung für „Belege bringen, keine Meinungen": Was ein Tech-Experte in deiner Architektur prüft.

Meeting-Ablauf

- Ergebnis-Abstimmung: Was sich ändert, für wen und wie gemessen wird

- Umfangsdefinition: dünner Slice, im und außerhalb des Umfangs, Abhängigkeiten

- Risiko-Pre-Mortem: Top-Risiken, Frühsignale und Verantwortliche

- Erfolgskennzahlen: Geschäfts-, Produktions- und Lieferungsmetriken plus Baseline-Plan

- Betriebsmodell: Entscheidungsrechte, Ceremonies, Definition of Done, Release-Strategie

Kickoff-Follow-up (innerhalb von 48 Stunden)

Ein kurzes Kickoff-Memo mit Entscheidungen und offenen Fragen senden. Wenn nichts anderes getan wird, das tun. Es verhindert „stille Uneinigkeit."

Kickoff-Lieferergebnisse, die Nacharbeit verhindern

Kickoff-Artefakte sollten leichtgewichtig, aber operativ sein.

| Lieferergebnis | Warum es wichtig ist | Mindestinhalt |

|---|---|---|

| Umfangsdefinition (eine Seite) | Verhindert Scope Drift | Ergebnis, Nutzer, im/außerhalb, Einschränkungen, Abhängigkeiten |

| Risikoregister | Macht Unsicherheit handhabbar | Risiko, Kategorie, Verantwortlicher, nächster Mitigationsschritt |

| Messplan | Macht Fortschritt objektiv | Metrikliste, Datenquellen, Dashboard-Links, Rhythmus |

| Definition of Done | Verhindert „fast fertig"-Schleifen | Qualitätsgates, Security-Checks, Deployierbarkeit, Observability |

| Entscheidungsprotokoll | Hält Architektur- und Produktentscheidungen konsistent | ADR-Stil-Notizen, Abwägungen, gewählte Option |

Eine starke Definition of Done umfasst typischerweise:

- Code reviewed und gemergt mit vereinbarten Qualitätsgates

- Automatisierte Tests auf dem richtigen Level für die Änderung

- Security-Baseline-Checks für Abhängigkeiten und Secrets

- Telemetrie für den neuen Flow hinzugefügt (Logs und Metriken mindestens)

- Durch die normale Pipeline deployierbar, mit definiertem Rollback-Ansatz

Für die Operationalisierung von Qualität ohne Eitelkeitsziele kann Wolf-Techs Metrik-fokussierter Ansatz helfen: Code-Qualitätsmetriken, die zählen.

Häufige Kickoff-Fehlermodi (und wie man sie vermeidet)

Das sind Muster, die bei echten Software-Projekten immer wieder auftauchen.

Die „Umfang ist eine Feature-Liste"-Falle

Wenn Umfang als Module geschrieben wird, streiten Teams später über Verhalten und Randfälle. Fix: Umfang als Fähigkeiten plus Akzeptanzsignale definieren.

Die „Integration später"-Falle

Integrationen sind selten „später". Sie bestimmen Datenstruktur, Fehlerbehandlung und betriebliches Verhalten. Die risikoreichste Integration in den dünnen Slice einbeziehen.

Die „Metriken nach dem Launch"-Falle

Wenn Messbarkeit verschoben wird, kann das Projekt nur nach Stakeholder-Stimmung beurteilt werden. Instrumentierung ist Teil des Umfangs.

Die „Keine Entscheidungsrechte"-Falle

Wenn niemand weiß, wer entscheidet, werden Entscheidungen in Slack getroffen und dann in Reviews neu verhandelt. Einen klaren DRI pro Domäne zuweisen (Product, Architektur, Security, Release).

Die „Wir reden nicht über Einschränkungen"-Falle

Einschränkungen sind keine Negativität – sie sind das, was einen Plan glaubwürdig macht. Explizit erfassen, besonders rund um Compliance, Zeitpläne und bestehende Plattformgrenzen.

Wann es sich lohnt, einen externen Experten einzubinden

Ein Kickoff hat besonders hohen Hebel mit einem erfahrenen Partner, wenn:

- Eine Legacy-Codebase und unklares Änderungsrisiko vorhanden ist

- Ein Stack und eine Architektur schnell validiert werden müssen

- Strenge Security-, Audit- oder Uptime-Erwartungen bestehen

- Ein dünner Slice schnell in Produktion benötigt wird, ohne Betreibbarkeit zu kompromittieren

Wolf-Tech ist spezialisiert auf Full-Stack-Entwicklung und technische Beratung in den Bereichen Delivery, Modernisierung, Cloud/DevOps und Architekturstrategie. Wenn du einen Kickoff willst, der einen realistischen Plan, messbare Erfolgskennzahlen und einen frühen Risiko-Burn-down-Pfad erzeugt, erkunde Wolf-Techs Ansatz unter Wolf-Tech und nutze die obigen Artikel, um Stakeholder vor dem ersten Sprint abzustimmen.