Individuelle Webanwendungsentwicklung: Was Sie von einem Dienstleister erwarten sollten

Den Kauf von Dienstleistungen zur individuellen Webanwendungsentwicklung kann man weniger mit dem Erwerb eines fertigen Produkts vergleichen als mit der Beauftragung eines Liefersystems. Der Mehrwert liegt nicht nur in „Entwicklern, die Code schreiben", sondern in einem wiederholbaren Weg, um den richtigen Umfang zu entdecken, ihn sicher zu bauen, zuverlässig zu liefern und ihn gesund zu halten, wenn sich Anforderungen, Traffic und Integrationen ändern.

Dieser Leitfaden erklärt, was man von einem professionellen Webanwendungsentwicklungspartner erwarten sollte, welche Lieferergebnisse man einfordern sollte, wie Zeitpläne typischerweise aufgeteilt werden und wie man versteckte Risiken frühzeitig erkennt.

Was „individuelle Webanwendungsentwicklung" enthalten sollte (von Anfang bis Ende)

Ein seriöser Anbieter sollte den gesamten Lebenszyklus abdecken können, auch wenn das interne Team Teile davon besitzt. In der Praxis umfassen individuelle Webanwendungsentwicklungsdienstleistungen typischerweise:

- Discovery und Scoping: Klärung von Outcomes, Nutzern, Einschränkungen und der Bedeutung von „fertig".

- UX und Product Design: Flows, Zustände (Laden, Fehler, Berechtigungen), Barrierefreiheit und Inhaltsstruktur.

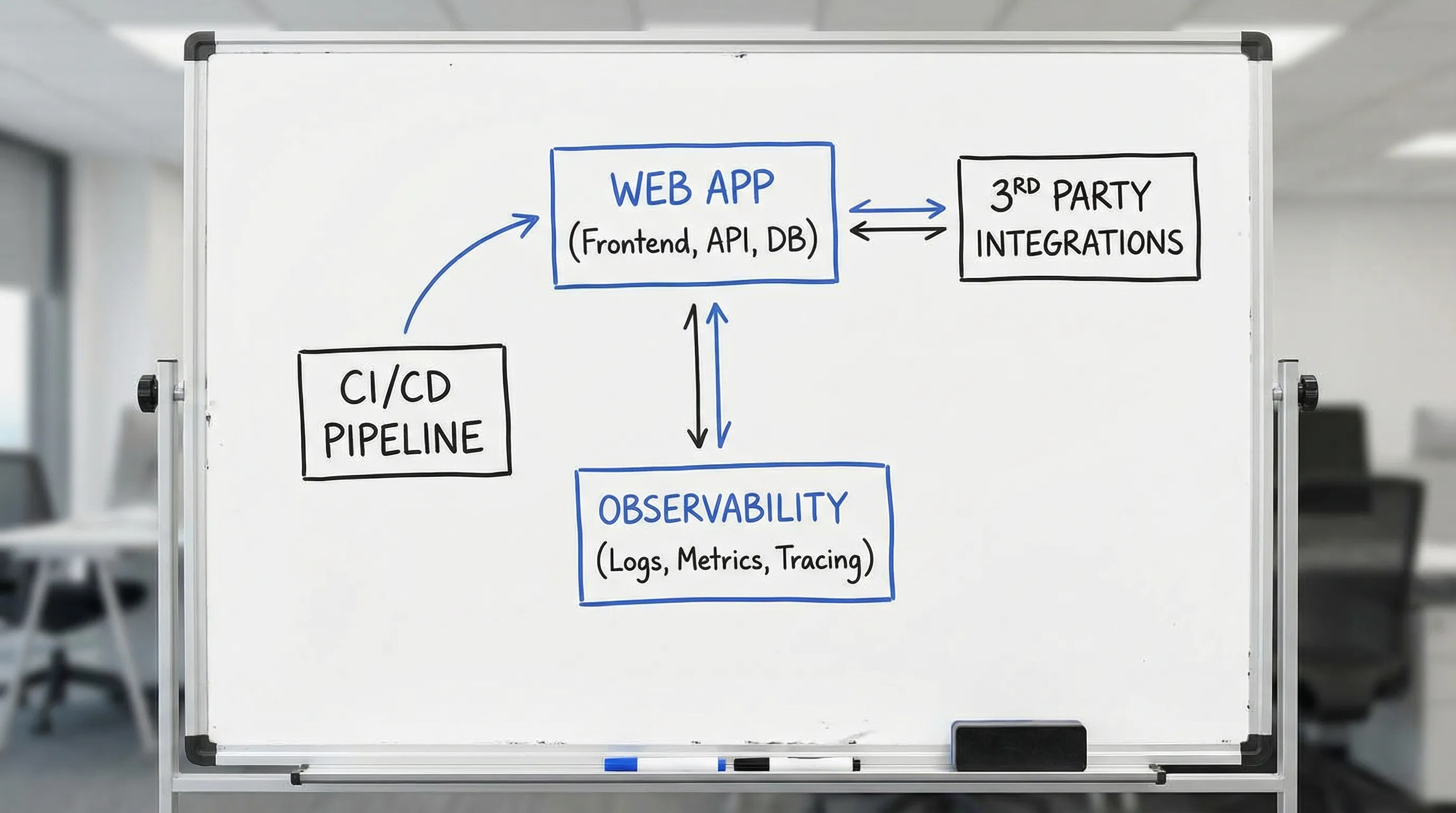

- Architektur und Tech-Stack-Strategie: Frontend, Backend/API, Daten, Integrationen und Plattformauswahl, die zu den Einschränkungen passt.

- Implementierung: Features mit überprüfbaren Inkrementen bauen, keine Big-Bang-Releases.

- Quality Engineering: Automatisierte Teststrategie, Quality Gates und Fehlervermeidung.

- Security Engineering: Threat Modeling, sichere Defaults, Dependency Hygiene und Release-Kontrollen.

- Cloud und DevOps: CI/CD, Umgebungen, Infrastructure as Code, Deployment-Strategie, Cost Guardrails.

- Observability und Betrieb: Logs, Metriken, Tracing, Alerting, Incident-Readiness und Performance-Monitoring.

- Post-Launch-Iteration: Verbesserungen basierend auf Nutzungsdaten, Support-Tickets und Business-Metriken.

Für eine schnelle Auffrischung, was technisch eine „Webanwendung" von einer Website unterscheidet, bietet Wolf-Tech eine solide Grundlage: Webanwendung: Was ist das und wie funktioniert sie?

Die Phasen, die man erwarten sollte (und was man in jeder Phase erhalten sollte)

Die meisten Webanwendungen scheitern aus vorhersehbaren Gründen: unklarer Umfang, fehlende nicht-funktionale Anforderungen, zu spät entdeckte riskante Integrationen und „Ops/Security fügen wir später hinzu". Ein reifes Engagement macht diese Risiken explizit und behandelt sie in der richtigen Reihenfolge.

Hier sind realistische Erwartungen, die beim Vergleich von Anbietern verwendet werden können.

| Phase | Ziel | Typische Lieferergebnisse | Ihre Inputs, die die Arbeit entblocken |

|---|---|---|---|

| Discovery und Alignment | Outcomes, Nutzer, Einschränkungen und messbaren Erfolg vereinbaren | Problemstellung, Umfangsgrenzen, priorisierte Risiken, High-Level-Backlog, Erfolgsmetriken | Stakeholder, Domänenexperten, Zugang zu bestehenden Systemdokumentation und Einschränkungen |

| UX-zu-Architektur-Alignment | Rewrites verhindern, indem Erfahrung und Systemverträge früh aligned werden | Wichtigste Nutzer-Journeys, Zustandsmodell (Happy Path plus Fehler), frühe API-Entwürfe, Performance-Budgets | Echte Workflows, Edge Cases, Compliance-Anforderungen, Marken-/Barrierefreiheitsbeschränkungen |

| Architektur-Baseline | Einen Standard-Pfad wählen, der sicher zu liefern und zu betreiben ist | Architekturdiagramm, ADRs (Entscheidungsaufzeichnungen), Integrationsplan, Datenmodelentwurf | Aktuelle Infrastruktur-Einschränkungen, Anbieter-/Drittanbieterverträge, Sicherheitsrichtlinien |

| Dünner vertikaler Slice | Machbarkeit end-to-end unter produktionsähnlichen Bedingungen beweisen | Funktionierender Slice durch UI, API, Daten, Auth, CI/CD, grundlegende Observability | Test-Nutzer, Umgebungszugang, repräsentative Datenbeispiele |

| MVP-Aufbau | Zum kleinsten vollständigen Produkt erweitern | Inkrementelle Releases, wachsende Testabdeckung, Betriebsrunbooks, Backlog-Refinement | Priorisierungsentscheidungen, Akzeptanzkriterien, UAT-Feedback |

| Launch-Readiness | Blast Radius reduzieren und Release umkehrbar machen | Release-Plan, Monitoring und Alerting, Rollback-Plan, SLOs/SLIs-Entwurf | Support-Eigentümerschaft, Incident-Kontakte, Launch-Kommunikation und Training |

| Betreiben und Verbessern | Zuverlässigkeit, Kosten und Liefergeschwindigkeit unter Kontrolle halten | Iterationsplan, Performance-Fixes, Security-Patching-Kadenz, Roadmap-Unterstützung | Nutzungsanalysen, Support-Tickets, Business-KPI-Feedback |

Zwei Wolf-Tech-Artikel, die tiefer in diese Mechanismen einsteigen (ohne Füllstoff), sind beim Evaluieren von Partnern wertvoll:

- Individuelle Webanwendung entwickeln: Von der Idee bis zum Launch

- Software-Projekt-Kickoff: Umfang, Risiken und Erfolgskennzahlen

Lieferergebnisse, die „Professional Services" von „Staff Augmentation" unterscheiden

Viele Teams engagieren Hilfe und erwarten eine App, erhalten aber einen Code-Haufen plus ein paar Slack-Nachrichten. Die Mindesterwartung sollte übertragbare Eigentümerschaft sein.

Ein professioneller Partner sollte Assets hinterlassen, die die weitere Entwicklung mit Zuversicht ermöglichen:

Produkt- und Entscheidungsartefakte

Leichtgewichtige, explizite Dokumentation sollte erwartet werden, die verhindert, dass dieselben Argumente jeden Sprint neu diskutiert werden:

- Eine klare, testbare Umfangserklärung und Erfolgsmetriken

- Ein Entscheidungsprotokoll (oft via ADRs) für wesentliche Architekturentscheidungen

- Ein Risikoregister mit Eigentümern und Maßnahmen

- Eine Definition of Done, die Produktionsbereitschaft einschließt, nicht nur Feature-Fertigstellung

Engineering-Artefakte

Diese sind die „Ernsthaftigkeit-Beweis"-Lieferergebnisse:

- Ein zugängliches Repository mit einem funktionierenden Build und einer vorhersehbaren Struktur

- Versionierte API-Verträge (und ein klarer Ansatz für Breaking Changes)

- Eine funktionierende CI-Pipeline, die Tests ausführt und Quality Gates durchsetzt

- Automatisierte Tests entsprechend dem Risikoprofil (kein Theater)

- Umgebungs- und Deployment-Dokumentation

Für eine detaillierte, käuferorientierte Checkliste, wie „gut von Anfang an" aussieht, ist dieser Wolf-Tech-Beitrag mit modernen Erwartungen abgestimmt: Individualsoftware-Leistungen: Was Sie standardmäßig erhalten sollten

Wie Qualität gehandhabt werden sollte (ohne Lieferung zu verlangsamen)

„Qualität" ist keine einzelne Aktivität – es ist eine Reihe von Einschränkungen, die Änderungen sicher halten. Die besten Partner behandeln Qualität als Lieferbeschleuniger.

Quality Gates erwarten, keine Heldentaten

Ein glaubwürdiges Team implementiert proaktiv:

- Code-Review-Normen (kleine Pull Requests, schnelle Review-Schleifen)

- Statische Analyse und Formatierung (konsistente Standards, reduziertes Review-Rauschen)

- Teststrategie-Klarheit (was durch Unit Tests, Integration Tests, End-to-End-Tests abgedeckt wird)

- Regressionsvermeidung (CI, das riskante Änderungen blockiert, plus Monitoring zum Erkennen von Durchbrüchen)

Wer lieber misst als rät, sollte outcome-verknüpfte Signale statt Vanity-Metriken verfolgen. Wolf-Techs Leitfaden zu Code-Quality-Metriken, die zählen ist ein starker Rahmen für die Alignment zwischen Käufer und Anbieter.

Performance sollte budgetiert und überwacht werden

Für nutzerorientierte Webanwendungen sollte Performance als Anforderung behandelt werden, nicht als Post-Launch-Überraschung. Viele Teams verwenden Core Web Vitals als praktische Baseline, insbesondere für öffentlich zugängliche Routen. Google pflegt die Referenzdokumentation für diese nutzerzentrierten Metriken: Core Web Vitals.

Ein guter Partner schlägt Performance-Budgets vor (z.B. Bundle-Size-Einschränkungen, API-Latenz-Ziele) und fügt Prüfungen hinzu, um Regressionen zu verhindern.

Wie Sicherheit im Engagement berücksichtigt werden sollte

Sicherheit ist eine Engineering-Disziplin, aber auch ein Beschaffungs- und Governance-Thema. Der Anbieter sollte Sicherheit früh, in klarer Sprache und verknüpft mit konkreten Kontrollen besprechen.

Mindesterwartungen für moderne individuelle Webanwendungen:

- Sichere Entwicklungspraktiken per Default (Secrets-Management, Least Privilege, sichere Konfiguration)

- Dependency- und Supply-Chain-Hygiene (Verständnis, was in Produktion läuft und wie es aktualisiert wird)

- Threat Modeling für kritische Flows (Auth, Zahlungen, Admin-Aktionen, Datenexport)

- Release-Sicherheit (Auditierbarkeit, Rollback-Strategie und Zugriffskontrollen)

Zwei glaubwürdige Referenzpunkte, mit denen viele reife Teams sich alignen:

- OWASP Top 10 für häufige Webanwendungsrisikokategorien

- NIST Secure Software Development Framework (SSDF) für einen governance-freundlichen Weg zur Organisation sicherer Entwicklungspraktiken

Nicht alles muss sofort implementiert werden, aber ein Partner sollte erklären können, was er standardmäßig tut, was optional ist und welche Nachweise im Repository und in der Pipeline zu sehen sein werden.

Zeitplanerwartungen (und warum „es kommt darauf an" nicht gut genug ist)

Zeitpläne variieren, aber ein Anbieter sollte trotzdem Bereiche angeben können und was diese beeinflusst. Wenn man nur „es kommt darauf an" bekommt, fehlt ein Planungsmodell.

Häufige Muster für individuelle Webanwendungen:

- Discovery und Alignment: oft 1 bis 3 Wochen für einen fokussierten Umfang, länger wenn Stakeholder fragmentiert oder Anforderungen unsicher sind.

- Dünner vertikaler Slice: oft 2 bis 6 Wochen, um end-to-end Machbarkeit (UI, API, Daten, Auth, Deployment) produktionsähnlich zu beweisen.

- MVP-Aufbau: gewöhnlich 6 bis 12+ Wochen, abhängig von Anzahl der Rollen, Integrationen und nicht-funktionalen Anforderungen.

- Launch-Readiness: überschneidet sich typischerweise mit der MVP-Arbeit, aber es sind mindestens 1 bis 2 Wochen fokussierter Härtung für Produktionsbereitschaft zu erwarten, wenn diese nicht von Anfang an eingebaut wurde.

Ein praktischer Weg, Zeitpläne ehrlich zu halten, ist die Definition von „fertig" als lieferbare Inkremente. Wolf-Techs breiteres Prozess-Framing in Software bauen: Ein praxisnaher Prozess für vielbeschäftigte Teams entspricht der Arbeitsweise hochleistungsfähiger Teams zur Reduzierung von Delivery-Risiken.

Wie die Zusammenarbeit funktionieren sollte (Rollen, Kadenz und Entscheidungsrechte)

Ein Webanwendungs-Engagement ist ein cross-funktionales Unterfangen. Auch wenn die Entwicklung ausgelagert wird, können Produktentscheidungen nicht ausgelagert werden.

Mindestens sollte Klarheit bestehen über:

Wer was entscheidet

Der Partner sollte explizite Entscheidungsrechte vorschlagen, zum Beispiel:

- Produktprioritäten und Akzeptanzkriterien (normalerweise das eigene Team)

- Architektur-Guardrails und technische Standards (gemeinsam, mit einem klaren technischen Eigentümer)

- Sicherheits- und Compliance-Einschränkungen (gemeinsam mit Sicherheits-/Compliance-Stakeholdern)

- Release-Go/No-Go-Kriterien (gemeinsam, frühzeitig definiert)

Wie Fortschritte berichtet werden

Statusberichterstattung sollte keine Folienpräsentation sein, sondern Nachweise aus dem Delivery-System:

- Gelieferte Inkremente in einer Staging- oder Vorschau-Umgebung

- Eine laufende Risikoliste mit Maßnahmen

- Gemessene Liefer- und Zuverlässigkeitssignale (viele Teams verwenden DORA-Metriken als Ausgangspunkt, siehe das Forschungsprogramm bei DORA)

Wer testen möchte, ob ein Anbieter dieses Engagement führen kann, findet in Wolf-Techs Käuferhandbuch So prüfen Sie Unternehmen für individuelle Softwareentwicklung einen praktischen Evaluierungsablauf und die einzufordernden Nachweise.

Was man bezüglich Technologieauswahl erwarten sollte (und wie man einen stack-getriebenen Modehype vermeidet)

Ein Partner sollte nie einen Stack wählen, weil „wir immer X verwenden". Er sollte ihn wählen, weil er zu den Einschränkungen der nächsten 12 bis 36 Monate passt.

Zu erwarten sind:

- Eine klare Erklärung der Architektur-Baseline (oft zunächst ein modularer Monolith, es sei denn, es gibt triftige Gründe für etwas anderes)

- Ein Plan für Integrationen und Daten, einschließlich der Behandlung von Breaking Changes und Migrationen

- Ein Deployment-Modell und betriebliche Annahmen (Runtime, Caching-Strategie, Observability, Kosten)

Wolf-Tech hat zwei starke Ressourcen, die als neutraler Maßstab bei Anbietergesprächen verwendet werden können:

- App-Technologien: Den richtigen Stack für Ihren Anwendungsfall wählen

- Webentwicklungstechnologien: Was 2026 wirklich zählt

Nach dem Launch: Was ein verantwortungsvoller Partner nicht tut

Eine Webanwendung wird „real", wenn sie in Produktion geht. Dann tauchen operative Lücken, Nutzerverhalten und Daten-Edge-Cases auf.

Mindestens sollte ein Post-Launch-Plan erwartet werden, der Folgendes abdeckt:

- Monitoring für nutzerwirksame Ausfälle und Performance-Regressionen

- Ein Patching-Ansatz für Dependencies und Sicherheitsupdates

- Ein Prozess für die Behandlung von Incidents und Support-Eskalationen

- Eine Methode zur Priorisierung von Verbesserungen basierend auf echten Nutzungsdaten

Wenn die App Legacy-Systeme berührt, hängt die Post-Launch-Stabilität stark von Integrationsnähten und sicheren Modernisierungsmustern ab. Wolf-Techs Legacy-Systeme modernisieren ohne den Geschäftsbetrieb zu stören ist ein gutes Playbook dafür, wie „sichere Änderung" in realen Organisationen aussieht.

Warnsignale beim Kauf von individuellen Webanwendungsentwicklungsdienstleistungen

Perfektion ist nicht nötig, aber vorhersehbare Fehlerquellen sollten vermieden werden:

- Vage Antworten darüber, was man am Ende „besitzen" wird (Repository-Zugang, Infrastruktur-Zugang, Dokumentation)

- „Wir fügen Tests später hinzu" oder „QA am Ende" als Standardplan

- Keine Erwähnung von Sicherheitspraktiken, Dependency-Risiken oder Release-Sicherheit

- Architekturentscheidungen, die vor Discovery, UX-Flows und dem Verstehen der Einschränkungen getroffen werden

- Große Meilensteine ohne zwischenzeitliche gelieferte Inkremente

- Keine operative Story (Monitoring, On-Call-Erwartungen, Incident-Handling)

Ein guter Partner wird diese Bedenken begrüßen, weil ihre frühzeitige Behandlung Nacharbeit reduziert und die Delivery-Geschwindigkeit schützt.

Wo Wolf-Tech passt

Wolf-Tech konzentriert sich auf den Aufbau, die Optimierung und Skalierung von Webanwendungen mit Full-Stack-Entwicklungs-Expertise, unterstützt durch Code-Quality-Consulting, Legacy-Code-Optimierung, Tech-Stack-Strategie und Cloud- und DevOps-Erfahrung.

Wer einen Build, einen Rebuild oder eine Modernisierungsinitiative evaluiert, sollte als nächsten Schritt Erwartungen und Nachweise frühzeitig alignen, bevor man sich auf ein langes Engagement einlässt. Wolf-Techs bestehende Leitfäden können als Checklisten verwendet werden, bevor die eigenen Anforderungen mit dem Team auf Wolf-Tech besprochen werden.